Series learn AI from 0: Cách mình scrape thông tin bài post & comment từ các group Facebook để research TA với workflow n8n

Ở bài trước mình đã share về cách mình dùng NotebookLM để tìm kiếm và tổng hợp thông tin với mục tiêu là hiểu tổng quan về thị trường xem có tiềm năng không và khoảng trống mình có thể nhảy vào là gì.

Ở bài này mình sẽ đi research xem đối tượng mục tiêu của mình đang quan tâm & thảo luận về điều gì.

Đọc thêm các bài khác của mình trong series Learn AI from 0 ^^

Cách mình làm là mình sẽ đi tổng hợp lại các bài viết & comment từ các cộng đồng (group) trên Facebook để hiểu những người có nhu cầu chuyển ngành qua Data Analyst người ta đang quan tâm đến những chủ đề gì, đang hỏi đáp nhau về những cái gì. Sau đấy mình sẽ có thể ứng dụng vào việc cải thiện nội dung khóa học, hoặc điều chỉnh lại phần định hướng truyền thông của mình.

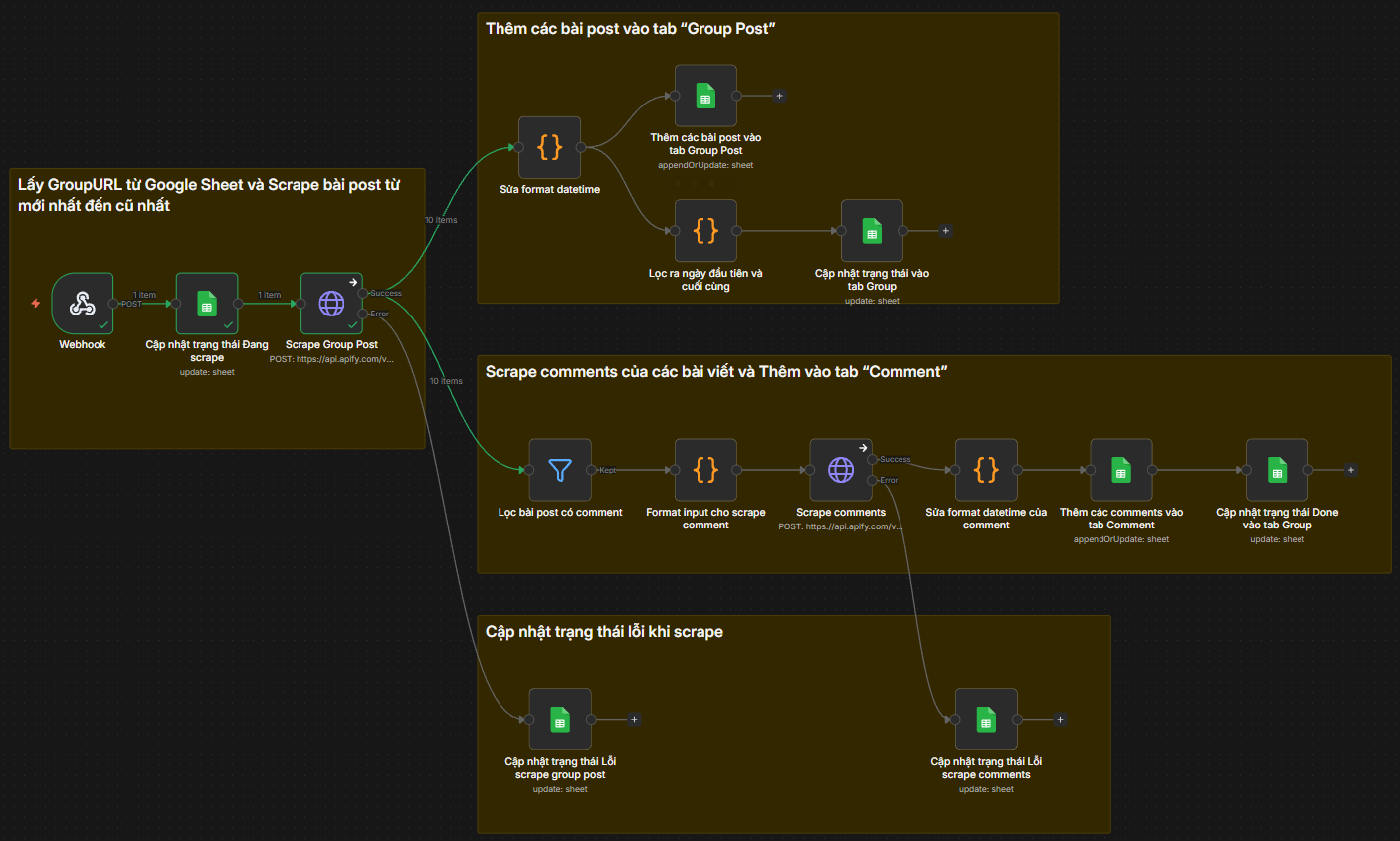

Cách làm cũ thì khá lâu, mình sẽ phải scan bằng cơm trong các group và tổng hợp lại (mình không rõ Python có làm được ko :)))) maybe có thể nhưng viết code cũng sẽ tốn khá nhiều thời gian) giải pháp là mình sử dụng 1 workflow n8n được cung cấp trong khóa học AI Marketing mình đang học.

Chụp cho bạn dễ hình dung workflow mình sử dụng, ở phần sau mình sẽ nói các step mình làm và demo outcome nha ^^

Bước 1: Tổng hợp link các group cần scrape

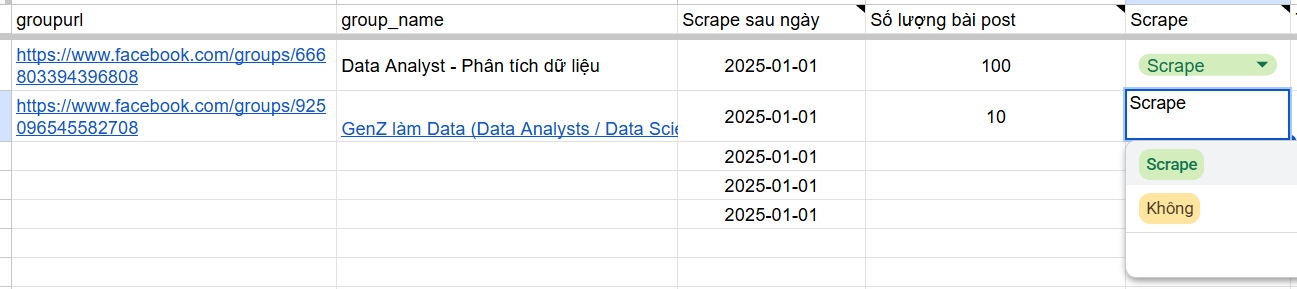

Đầu tiên mình sẽ cung cấp link của các group đối thủ. Phần này để chọn được group chất lượng thì mình làm thủ công. Trong bài demo này mình tạm list ra 2 group thôi.

Ngoài ra, mình sẽ note cả thời gian muốn bắt đầu scrape & số lượng bài post (2 cái này tương đối quan trọng để giới hạn số lượng data). Ngoài ra mình cũng có 1 cột Scape để lúc nào mình chuyển qua trạng thái scrape thì luồng sẽ bắt đầu chạy.

Bước 2: Scrape bài post trong group

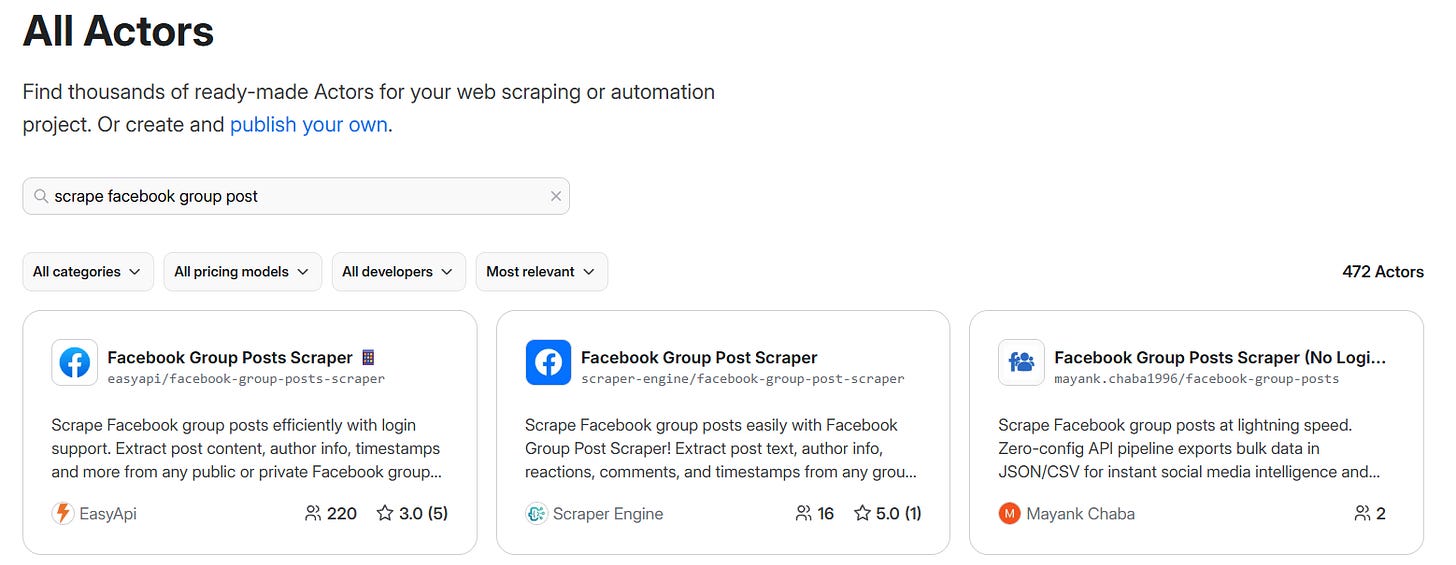

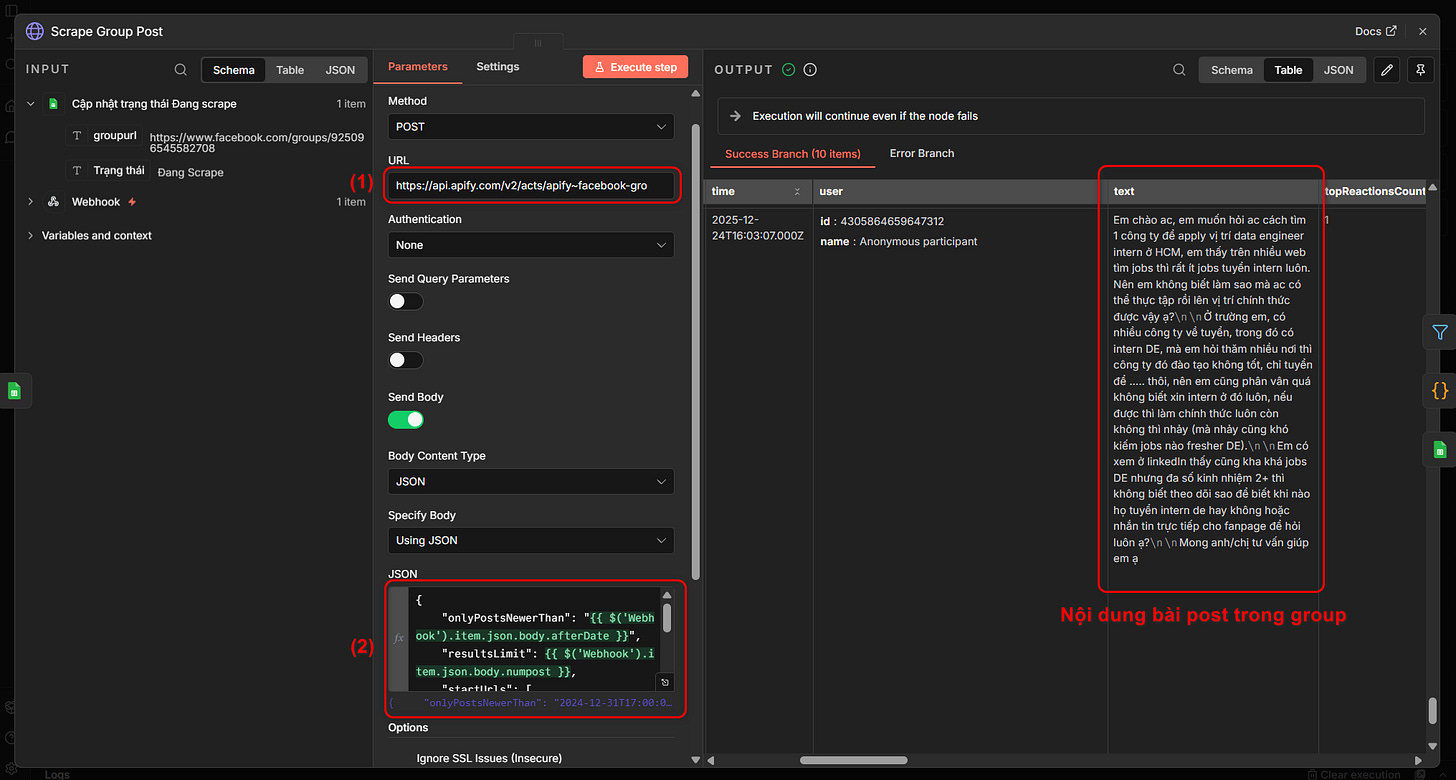

Ở đây mình sử dụng 1 actor của Apify tương tự như mình sử dụng bài sharing về việc build luồng n8n để scrape data Linkedin. Có khá nhiều bạn có thể thử test nha.

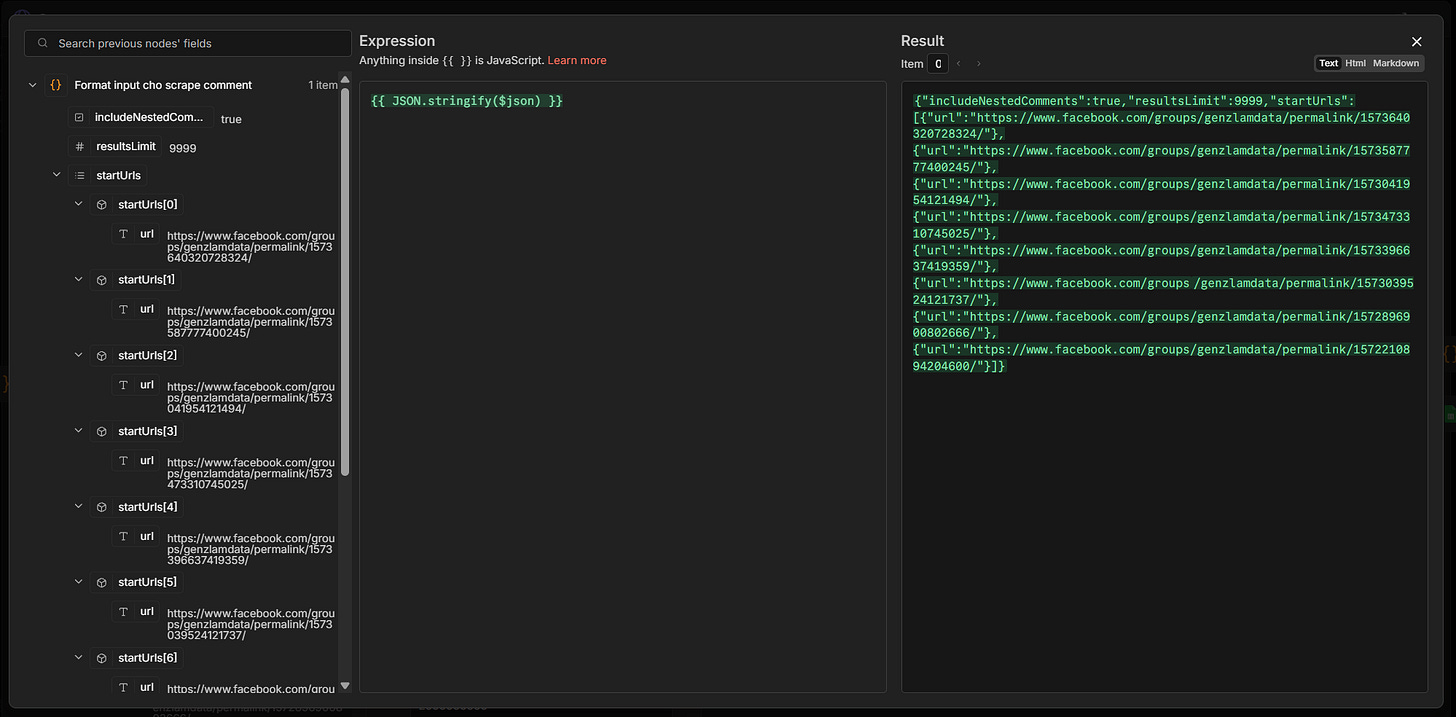

Sau khi chọn cho mình một Actor phù hợp để scape data, mình sử dụng node HTTP Request trong n8n.

(1) Lấy API của actor bỏ vào phần URL trong node

(2) Sử dụng JSON code để yêu cầu actor scrape từ ngày nào, scrape bao nhiêu bài

Và bạn có thể thấy outcome trả về bên phải.

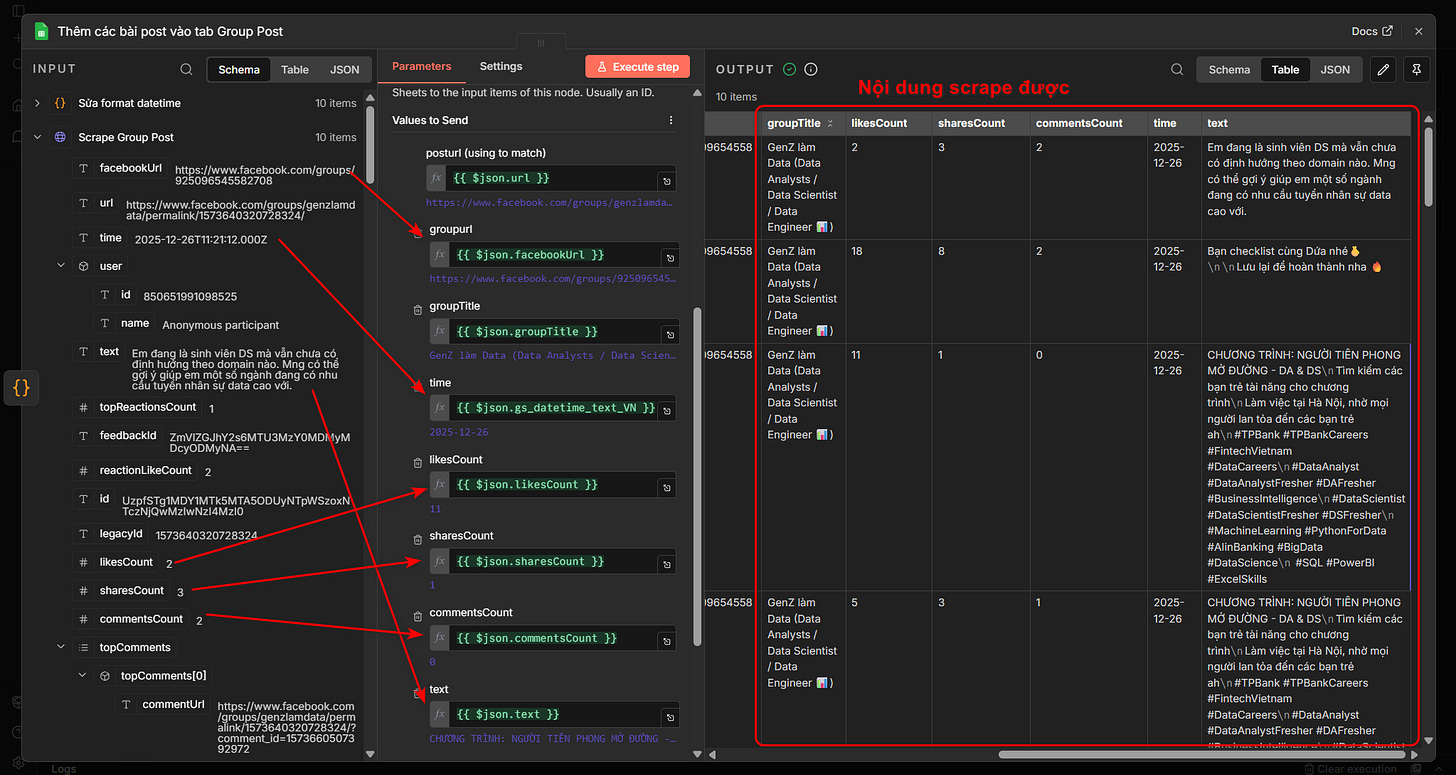

Bước 3: Update kết quả vào file Google Sheet

Phần này chỉ đơn giản là mình tạo 1 file Google Sheet với các cột có sẵn. Sau đó xử dụng node Append and update row in sheet trong n8n và kéo các cột tương ứng vào:

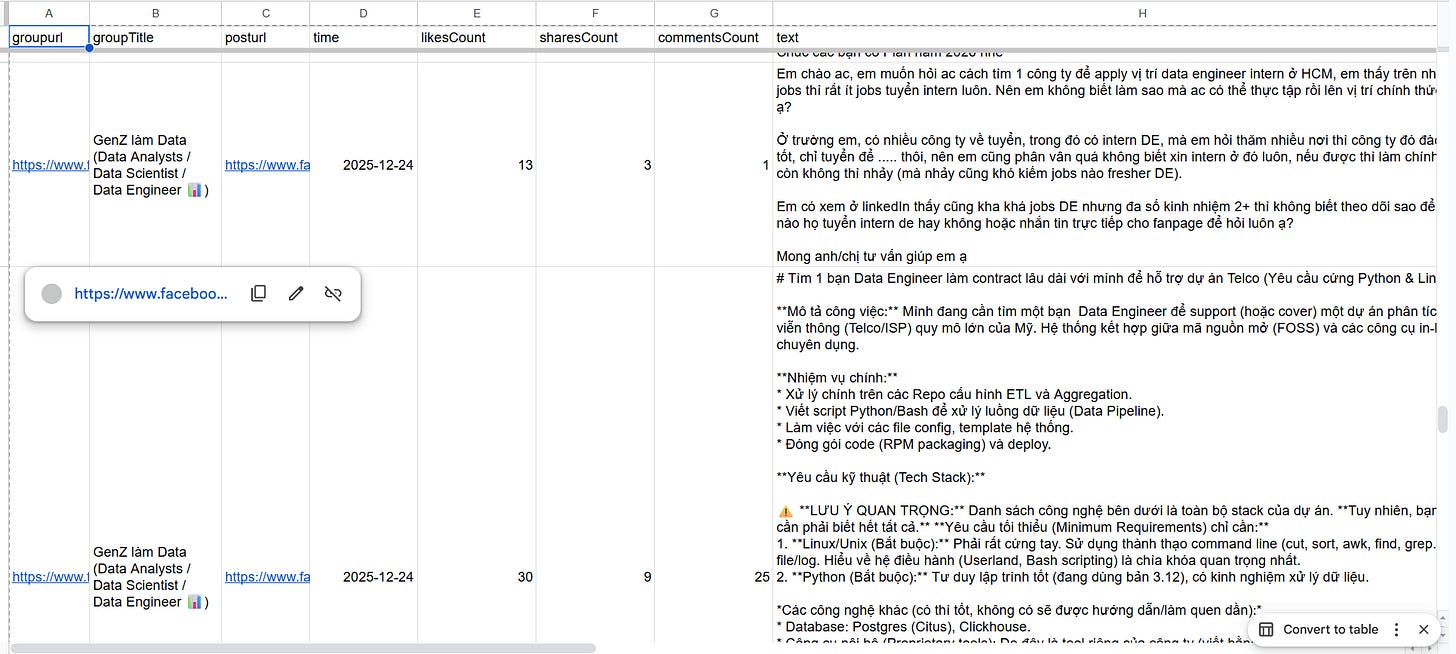

Đây là kết quả trong file Google Sheet:

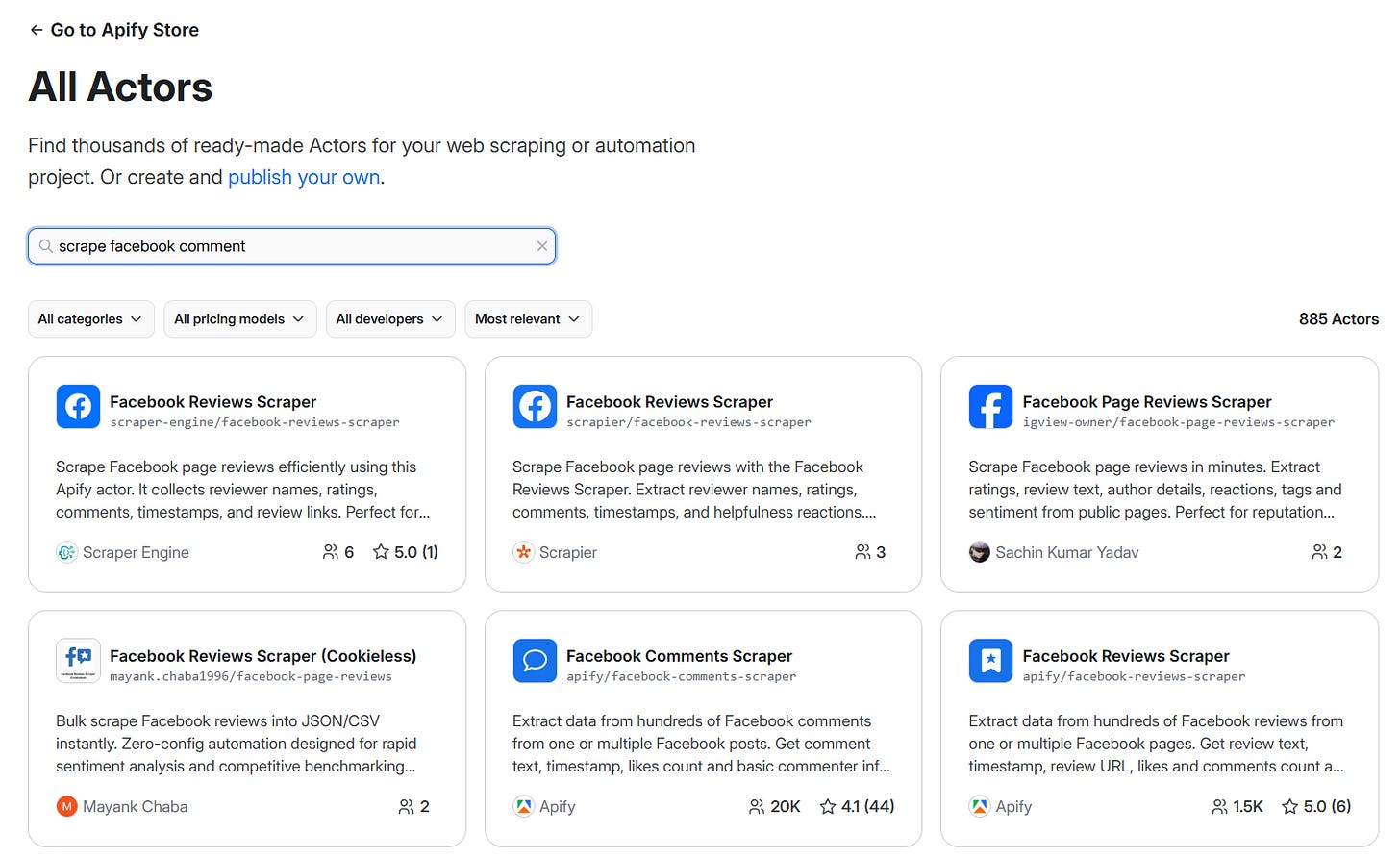

Bước 4: Scrape comments của các post vừa scrape được

Ở đây mình sử dụng 1 actor khác, bạn có thể search trong store có khá nhiều, cái nào free thì mình dùng ^^

Cũng tương tự mình sử dụng node HTTP Request trong n8n.

(1) Lấy API của actor bỏ vào phần URL trong node

(2) Sử dụng JSON code để input cho actor hết đống link URL group post vừa scrape được ở bước trước

À trước đó bạn nhớ filter ra những bài nào có comment để scrape nha.

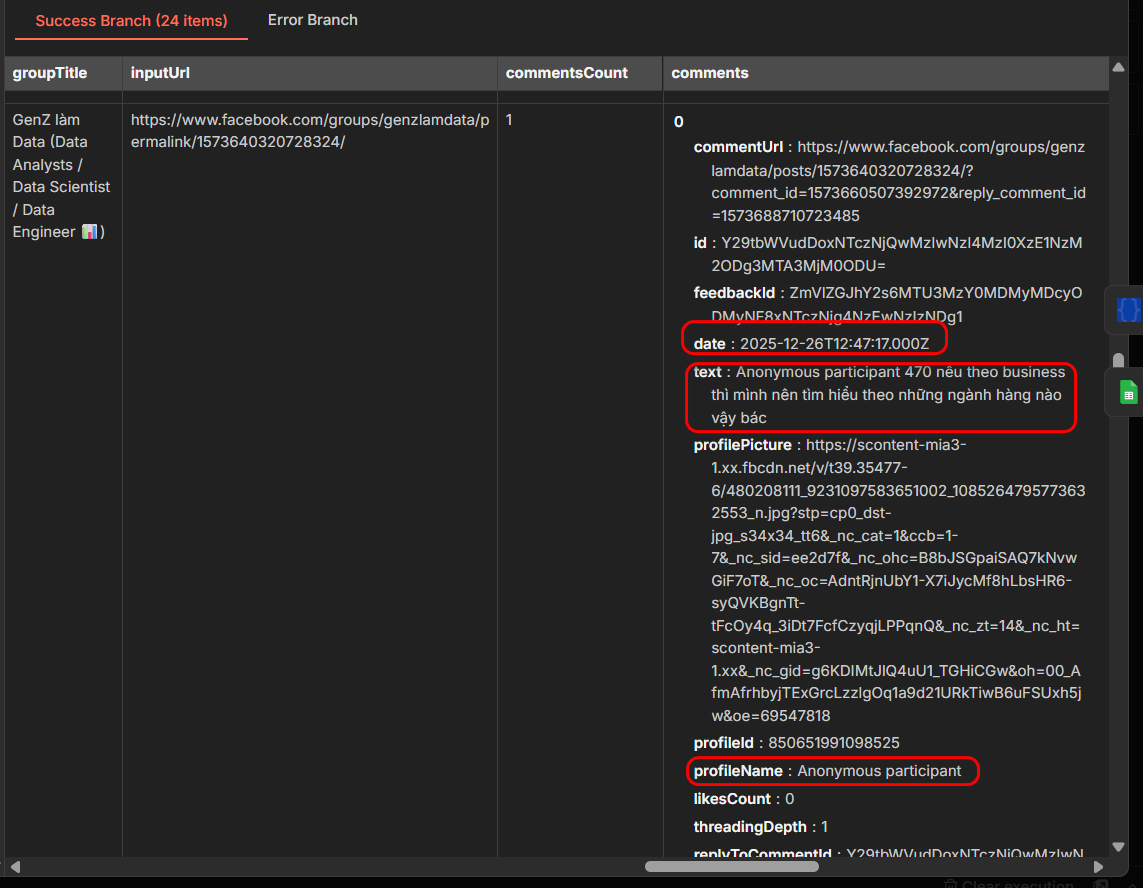

Sau khi chạy node thì mình sẽ lấy được ra các comment trong từng post thế này. Có thể lấy được từ ngày comment, nội dung của comment, tên của người comment,…

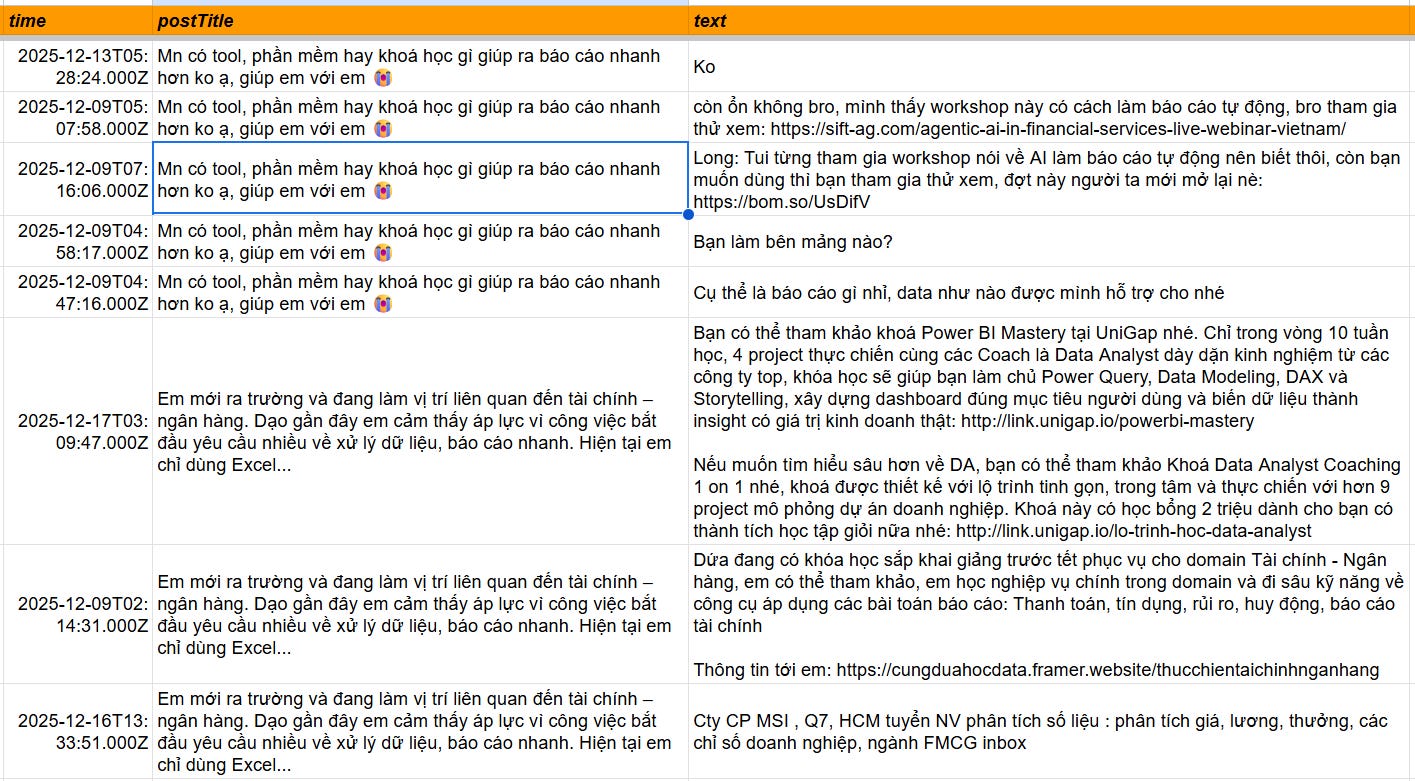

Sau đó mình sẽ update vào Sheet tương tự như bước 3 và được outcome thế này:

Tạm kết

Vậy mình đã vừa share với bạn phần scrape post & comment từ Facebook group một concept khá hay trong khóa AI Marketing mình đang học.

Bài này hơi dài nên còn phần scrape data về rồi thì phân tích thế nào mình sẽ sharing trong post sau nha ^^ nãy mới học xong có mấy cái cũng hay lắm để mình thực hành cái rồi share.

Bạn có thể đọc thêm các bài khác của mình trong series Learn AI from 0 nha ^^

Chúc bạn có một buổi tối vui vẻ ^^