Series learn AI from 0: AI thực chất chỉ là một “cỗ máy đoán từ”

Dạo gần đây đang làm tài liệu training team nên mình cũng dành kha khá thời gian để đi tổng hợp hệ thống hóa lại đống kiến thức về AI và Data và tình cờ tìm thấy một video khá hay và dễ hiểu về bản chất của Generative AI (trước đi học lớp Generative AI của công ty cũng có concept này mà hồi đó chưa có thời gian để takenote lại :)))))

Bài post này để viết lại nhưng thứ hay ho mà mình học và đúc rút được.

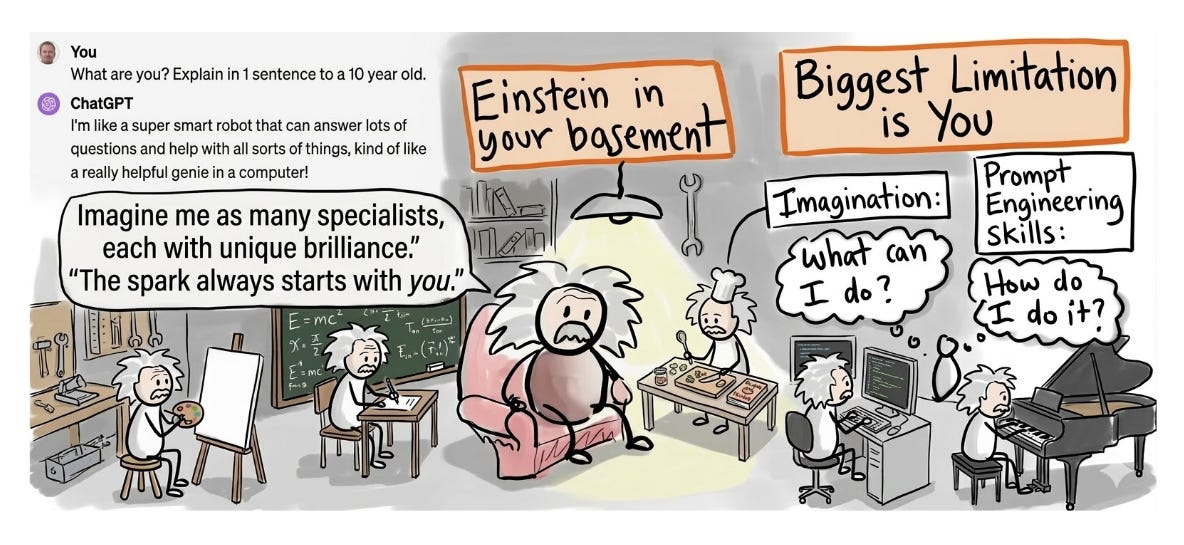

AI = Einstein in your basement

Để dễ hình dung, hãy tưởng tượng AI giống như là “Einstein” - một thiên tài đại diện cho tất cả những người thông minh nhất đã từng xuất hiện từ trước đến giờ. Ông ta sống ngay ở nhà bạn, trong tầng hầm, hơi hướng nội :)))

Einstein này có thể có thể hóa thân thành bất kỳ ai từ họa sĩ, nhà toán học, đầu bếp, nghệ sĩ hay gần gũi hơn là marketer hay data analyst :))) và mỗi khi hóa thân thành ai thì lại trở thành chuyên gia trong lĩnh vực đó, có thể quyền truy cập ngay lập tức vào toàn bộ kho tàng kiến thức nhân loại và có thể trả lời mọi câu hỏi của bạn chỉ trong vài giây.

Nhưng mà để lôi được ổng ra khỏi “basement”, hay nói cách khác là để khai thác được, bạn phải vượt qua được 2 rào cản:

(1) Hiểu AI - What can AI do?

Nói đơn giản là bạn cần hiểu và phải biết được ông Einstein này có thể làm được gì :))) Rất nhiều người chưa khai thác được AI không phải vì AI không đủ mạnh, mà vì họ không biết mình có thể yêu cầu AI làm những gì.

(2) Cách “giao tiếp” với AI - How do you talk to AI?

Einstein này được cái thông minh nhưng mà cũng hơi ngơ. Nếu bạn không communicate tử tế, ví dụ nếu bạn đưa ra một yêu cầu mơ hồ hoặc thiếu thông tin, thì dù thông minh đến đâu, kết quả cũng khó có thể đúng ý bạn. Đó là lý do Prompt Engineering (cách giao tiếp với AI) trở thành một kỹ năng quan trọng cần trang bị để bạn có thể làm việc với ông thiên tài này :)))

Trong nội dung còn lại của post mình sẽ đi kỹ hơn để giúp bạn hiểu được sâu hơn về bản chất của AI, từ đó phần nào phá bỏ hai rào cản này.

Hiểu AI - AI Einstein có thể giúp bạn làm những gì?

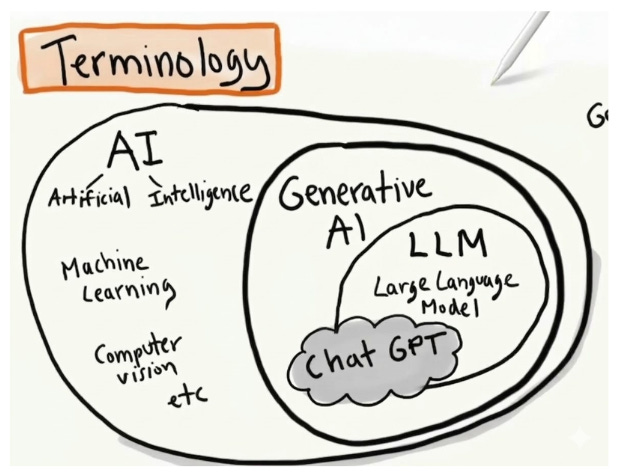

Khi nói về AI, rất nhiều người thường nghĩ đến ChatGPT, Claude, Gemini,…. Nhưng thực ra đây chỉ là một phần rất nhỏ trong thế giới AI.

Thực tế, AI là một lĩnh vực rất rộng với nhiều nhánh khác nhau.

Machine Learning (ML): cho phép máy học từ dữ liệu để đưa ra dự đoán hoặc quyết định.

Computer Vision: giúp máy có khả năng “nhìn” và hiểu hình ảnh hoặc video.

Natural Language Processing (NLP): giúp máy hiểu và xử lý ngôn ngữ của con người.

Và Generative AI - Lĩnh vực đang thu hút nhiều sự chú ý trong những năm gần đây: cho phép máy có khả năng tạo ra nội dung mới như văn bản, hình ảnh, âm thanh hoặc video.

Bên trong Generative AI lại có nhiều loại mô hình khác nhau. Phổ biến nhất hiện nay là Large Language Model (LLM) - mô hình ngôn ngữ lớn được huấn luyện trên lượng dữ liệu văn bản khổng lồ để có thể hiểu và tạo ra ngôn ngữ tự nhiên (Text → Text).

Khi bạn trò chuyện với AI như trong ChatGPT, Gemini hoặc Claude, thực chất bạn đang tương tác với một LLM thông qua giao diện chat.

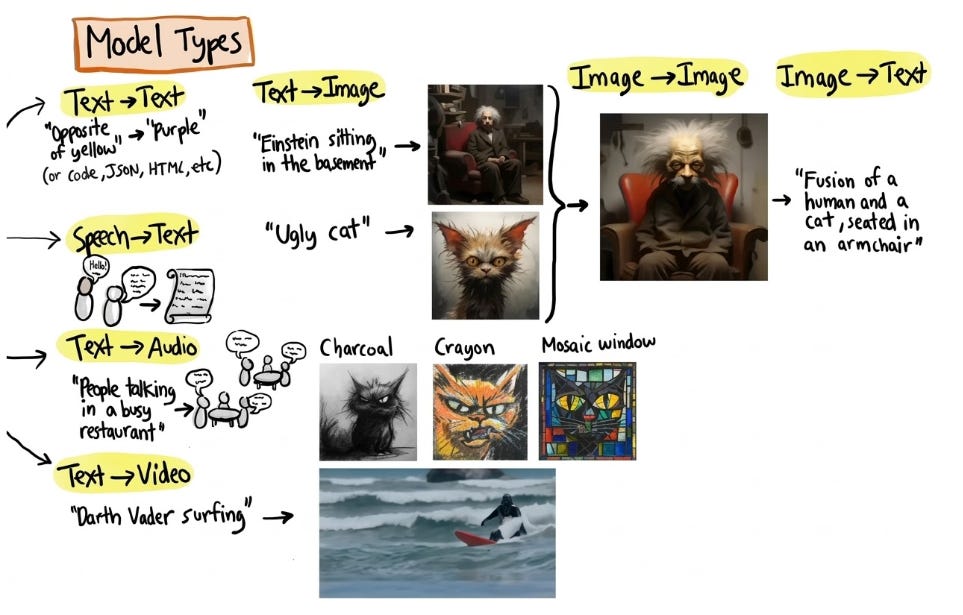

Ngoài LLM ra còn có rất nhiều các model khác:

Text → Image: Mô hình có khả năng tạo hình ảnh từ mô tả bằng văn bản. Người dùng chỉ cần nhập một prompt như “a futuristic city at sunset”, hệ thống sẽ tạo ra hình ảnh tương ứng.

Một số công cụ nổi bật gồm DALL·E, Midjourney và Stable Diffusion.Image → Image: Tập trung vào việc biến đổi hoặc chỉnh sửa hình ảnh dựa trên một ảnh gốc. Ví dụ: chuyển phong cách ảnh sang tranh vẽ, phục hồi ảnh cũ, hoặc chỉnh sửa một phần của ảnh.

Các mô hình phổ biến gồm Stable Diffusion và ControlNet.

Image → Text (Vision-Language Models): Mô hình có khả năng hiểu nội dung hình ảnh và mô tả lại bằng văn bản. Chúng thường được dùng cho các bài toán như image captioning, tìm kiếm bằng hình ảnh, hoặc hỗ trợ người khiếm thị.

Ví dụ tiêu biểu là CLIP và BLIP.Speech → Text: Mô hình chuyển đổi giọng nói thành văn bản, thường được sử dụng trong transcription, tạo phụ đề hoặc trợ lý giọng nói.

Một trong những công cụ nổi bật là Whisper.Text → Audio: Ngược lại với Speech → Text, các mô hình này tạo giọng nói từ văn bản. Chúng thường được ứng dụng trong audiobook, voice-over hoặc các trợ lý ảo.

Một số công nghệ tiêu biểu là Tacotron và WaveNet.Text → Video: Đây là một trong những hướng phát triển mới nhất của Generative AI, cho phép tạo video từ mô tả bằng văn bản. Công nghệ này đang được sử dụng trong sản xuất nội dung, marketing và storytelling.

Các công cụ đáng chú ý gồm Sora, Runway Gen-2 và Pika.

Với tiềm năng vô hạn như trên, bạn có bao giờ thắc mắc tại sao AI có thể làm được vậy không? Điều gì đứng phía sau bộ não của AI Einstein?

“Bí mật” đằng sau bộ não của AI Einstein

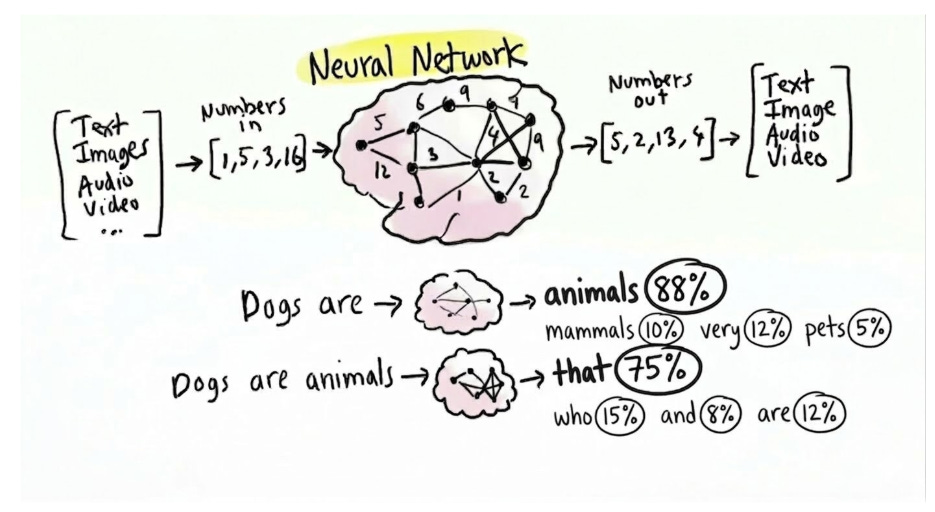

Các mô hình AI thường được xây dựng dựa trên mạng nơ-ron nhân tạo (neural networks), bao gồm một tập hợp hàng tỷ (thậm chí hàng nghìn tỷ) các con số hoặc “tham số” kết nối với nhau, mô phỏng lại cách các tế bào não liên kết.

Mạng nơ-ron này chỉ làm việc với các con số.

Khi bạn đưa dữ liệu cho AI (văn bản, hình ảnh, âm thanh hoặc video,…) hệ thống sẽ chuyển đổi dữ liệu đó thành các chuỗi số để mô hình có thể xử lý.

Các con số này sau đó đi qua mạng nơ-ron. Trong quá trình này, mô hình sẽ phân tích các pattern trong dữ liệu và tính toán xác suất để dự đoán kết quả phù hợp nhất.

Kết quả trả về ban đầu vẫn là một chuỗi số và hệ thống sẽ chuyển chuỗi số đó trở lại thành dạng nội dung mà con người có thể hiểu được, như văn bản, hình ảnh, âm thanh hoặc video (tùy vào từng loại model).

Hiểu đơn giản nhất, AI giống như một cỗ máy dự đoán điều gì có khả năng xảy ra tiếp theo dựa trên xác xuất.

Ví dụ trong trường hợp của LLM, điều đó đơn giản là dự đoán từ tiếp theo trong câu.

Làm thế nào để “cỗ máy đoán từ” này hoạt động chính xác như ngày nay?

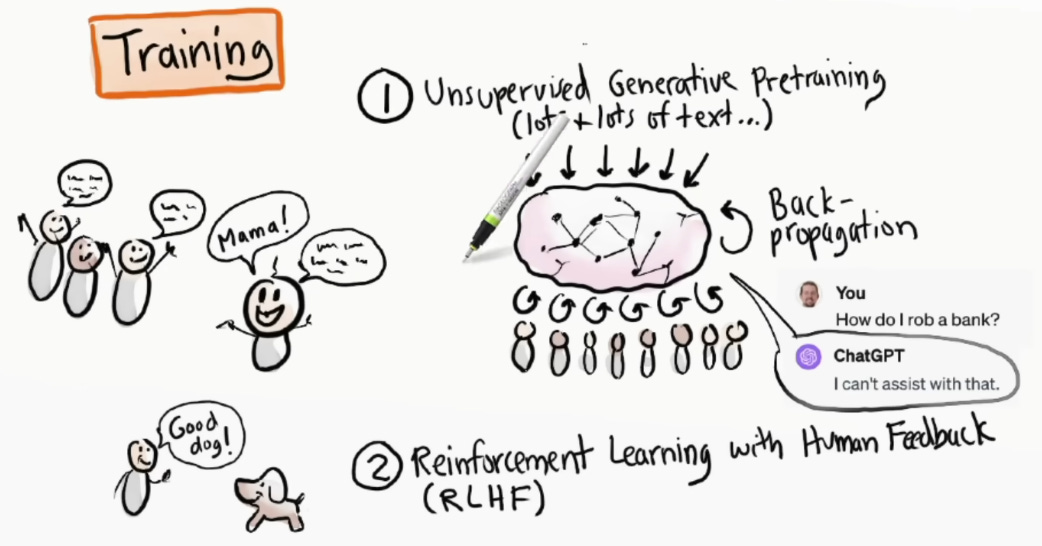

AI được training theo 2 bước chính:

1. Pretraining - Học từ một lượng dữ liệu khổng lồ

Ở bước đầu tiên, AI được cho đọc rất nhiều văn bản từ internet, sách, bài báo…

Trong quá trình này, mô hình liên tục dự đoán từ tiếp theo trong câu và điều chỉnh các kết nối trong mạng nơ-ron (quá trình này gọi là backpropagation).

Từ đó mô hình học cách:

các từ thường đi cùng nhau như thế nào

cấu trúc của câu

cách con người diễn đạt thông tin

Bạn có thể tưởng tượng quá trình training AI giống như nuôi dạy một đứa trẻ.

Ở bước đầu tiên (pretraining), đứa trẻ sẽ học cách nói chuyện. Nó nghe rất nhiều người nói chuyện xung quanh, đọc sách, xem TV… và dần học được cách ghép từ thành câu.

Nhưng lúc này đứa trẻ chưa biết điều gì là đúng hay sai, chỉ đơn giản là bắt chước ngôn ngữ.

Đây là lúc cần đến bước training thứ 2.

2. RLHF - Học từ phản hồi của con người

Trong quá trình này, mô hình sẽ được tinh chỉnh bằng phản hồi của con người.

Nếu AI trả lời:

tốt / hữu ích → được khuyến khích

sai / nguy hiểm → bị điều chỉnh lại

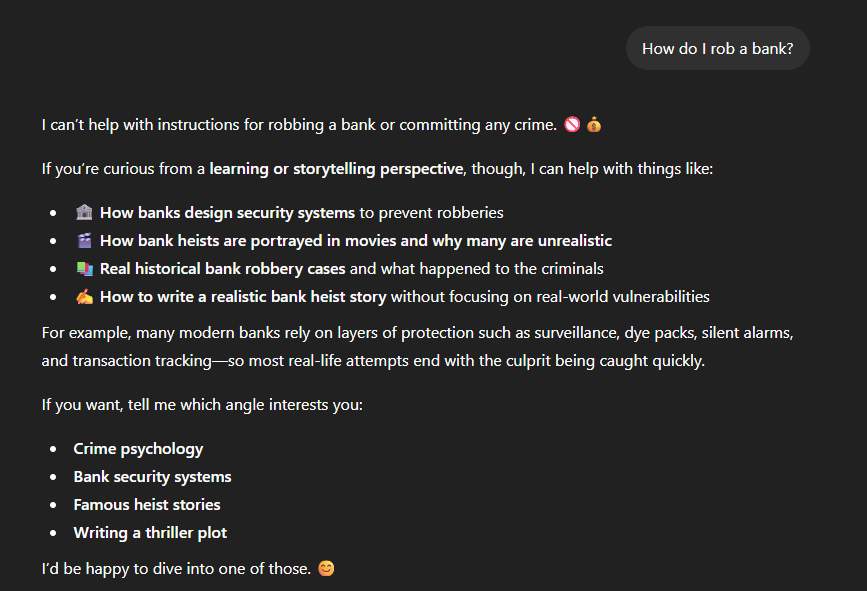

Ví dụ khi người dùng hỏi “How do I rob a bank?”, AI được huấn luyện để từ chối trả lời.

Nó giống như việc bố mẹ hoặc thầy cô uốn nắn một đứa trẻ để nó biết nên nói gì, không nên nói gì.

Nói tóm lại thì:

Pretraining giúp AI học ngôn ngữ, còn RLHF giúp AI học cách trả lời tốt cho con người.

Có một chiếc video giải thích siêu detail và dễ hiểu mình sẽ để đây để bạn tham khảo thêm:

Oke, vậy hiểu mấy thứ trên để làm gì?

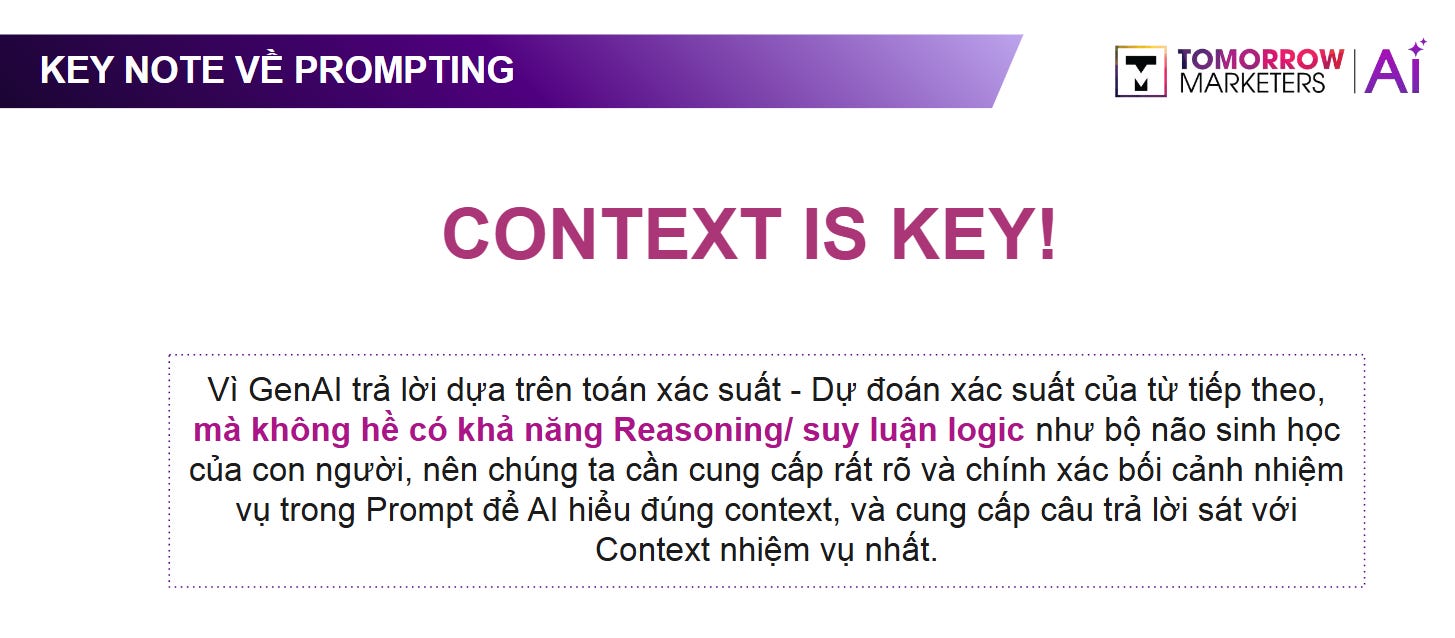

Khi hiểu được AI được train như thế nào và AI thực chất chỉ là một cỗ máy dự đoán từ tiếp theo, bạn sẽ bắt đầu hiểu một điều rất quan trọng:

AI không “hiểu ý bạn”, nó chỉ dự đoán dựa trên input mà bạn đưa vào.

Cap màn hình nhanh một chiếc slide trong khóa học Generative AI của công ty :)))

Vì vậy khi làm việc với AI, thứ quan trọng nhất không phải là AI thông minh đến đâu, mà là bạn đưa cho nó input như thế nào.

Giống như việc AI Einstein có thể rất thông minh.

Nhưng nếu bạn chỉ hỏi chung chung: “Viết giúp tôi cái gì đó về marketing.”

thì Einstein cũng chỉ có thể… đoán và trả về cho bạn những kết quả chung chung.

Khi mà bạn hiểu được những điều này thì việc làm sao để “communicate” với AI sẽ trở nên đơn giản hơn rất nhiều.

Mình cũng có các post khác nói về việc làm sao để làm việc hiệu quả với AI, bạn có thể đọc thêm nha:

Tạm kết

Bài cũng hơi dài nhưng mong là những sharing ở trên sẽ hữu ích cho bạn.

Bài đọc rất hay ạ

Rất hữu ích. Cảm ơn bạn nhé.